AWS SageMaker Jumpstart에서 'Solar'의 잠재력을 확인해 보세요

2024/04/04 | 작성자: 최유정 (테크니컬 라이터)오늘은 업스테이지에서 만든 파운데이션 모델인 'Solar'를 소개합니다. Solar는 Amazon SageMaker로 100% 사전 학습된 대규모 언어 모델(LLM)로, 뛰어난 성능과 속도를 자랑합니다. Solar는 컴팩트한 크기와 강력한 실적을 활용하여 목적별 학습에 특화되어 언어, 도메인 및 작업 전반에 걸쳐 다용도로 활용할 수 있습니다.

이번 콘텐츠를 통해 텍스트 생성 모델 Solar의 강점과 이 모델을 훈련하고 SageMaker 플랫폼에 업로드하는 과정을 확인해 보실 수 있습니다.

이제 Amazon SageMaker JumpStart 내에서 Solar를 사용하여 강력하고 목적에 맞게 훈련된 LLM을 직접 구축해 보세요.

업스테이지와 Solar LLM 알아보기

업스테이지는 업계 최고 수준의 문서 처리 엔진과 대규모 언어 모델(LLM)로 업무 효율성을 높여주는 AI 스타트업입니다. 업스테이지에서는 업무용 AGI를 목표로 '문서 AI'로 단순 업무를 자동화하고, LLM 'Solar'로 업무 생산성을 향상하는 데 기여하고자 합니다.

2023년 12월, Solar는 허깅 페이스의 오픈 LLM 리더보드에서 정점에 도달하며 큰 반향을 일으켰습니다. 훨씬 적은 수의 파라미터를 사용하는 Solar는 GPT-3.5와 비슷한 수준의 응답을 제공하면서도 2.5배 더 빠릅니다. Solar가 성능 저하 없이 LLM 모델의 다운사이징을 혁신적으로 개선한 방법을 소개해 드리겠습니다.

Upstage LLM ‘Solar’ is the top-performer amongst <13B open-source models in HuggingFace

Solar는 허깅 페이스의 오픈 LLM 리더보드에서 1위를 차지했을 뿐만 아니라 특정 도메인 및 작업에서 특수 훈련된 모델로 GPT-4를 능가하는 성능을 보였습니다.

목적에 맞게 훈련된 모델을 통해 GPT4보다 뛰어난 성능을 발휘하는 Solar LLM

1. AWS SageMaker로 Solar 활용하기

저희는 Amazon SageMaker의 도움을 받아 전체 구축 프로세스를 탐색했습니다. 이 완전 관리형 머신 러닝 서비스를 통해 ML 모델을 신속하게 구축, 학습, 배포하여 프로덕션에 바로 사용할 수 있는 호스팅 환경으로 전환할 수 있었습니다. 업스테이지에서 이전에 활용했던 인프라와 비교했을 때, AWS SageMaker는 트레이닝 단계에서 약 2배, 배포 단계에서 3.5~5배 더 빠른 성능 향상을 보여주었습니다.

2. 기본 아키텍처

Solar의 기본 아키텍처는 32층 라마 2 구조를 기반으로 하며, 라마 2 아키텍처와 호환되는 최고 성능의 모델 중 하나인 미스트랄 7B의 사전 학습된 가중치로 초기화됩니다.

3. Depth Up-scaling (DUS)

Solar는 어떻게 컴팩트하면서도 놀랍도록 강력해질 수 있었을까요? Solar는 깊이별 스케일링과 지속적인 사전 트레이닝으로 구성된 'Depth Up-scaling(DUS)' 방식을 활용했습니다. DUS를 사용하면 mixture-of-experts와 같은 다른 확장 방법보다 훨씬 간단하고 효율적으로 작은 모델을 확대할 수 있습니다.

Mixture of Experts (MoE)과 달리 DUS는 복잡한 변경이 필요하지 않습니다. 추가 모듈이나 역동성이 필요하지 않으며, DUS는 HuggingFace와 같이 사용하기 쉬운 LLM 프레임워크와 즉시 호환되며 모든 트랜스포머 아키텍처에 적용할 수 있습니다.(논문 읽기 → )

컴포넌트와 함께 Solar 활용하기

컴포넌트가 필요한 이유는 무엇인가요?

여러분이 비즈니스에서 LLM을 구현할 때 가장 우려되는 점은 무엇인가요? 많은 사람들이 가장 우려하는 것은 환각 성향으로 인한 LLM의 불안정성입니다. 응답이 자의적으로 보이는 경우가 많은데 어떻게 LLM이 적절한 결과를 제공한다고 믿을 수 있을까요?

Upstage는 데이터로 답변의 근거를 마련하는 RAG와 답변을 다시 확인하는 근거 확인 기능을 지원합니다. 하지만 이 환각 방지 시스템을 가동하고 작동시키려면 먼저 데이터를 LLM에 맞게 준비해야 합니다. 저희는 레이아웃 분석을 통해 귀하의 비정형 데이터를 LLM이 잘 이해할 수 있도록 변환합니다. 이 데이터는 RAG 및 접지 상태 확인과 함께 LLM Solar에 제공되어 데이터를 실제로 활용할 수 있도록 합니다.

2. 레이아웃 분석 정보

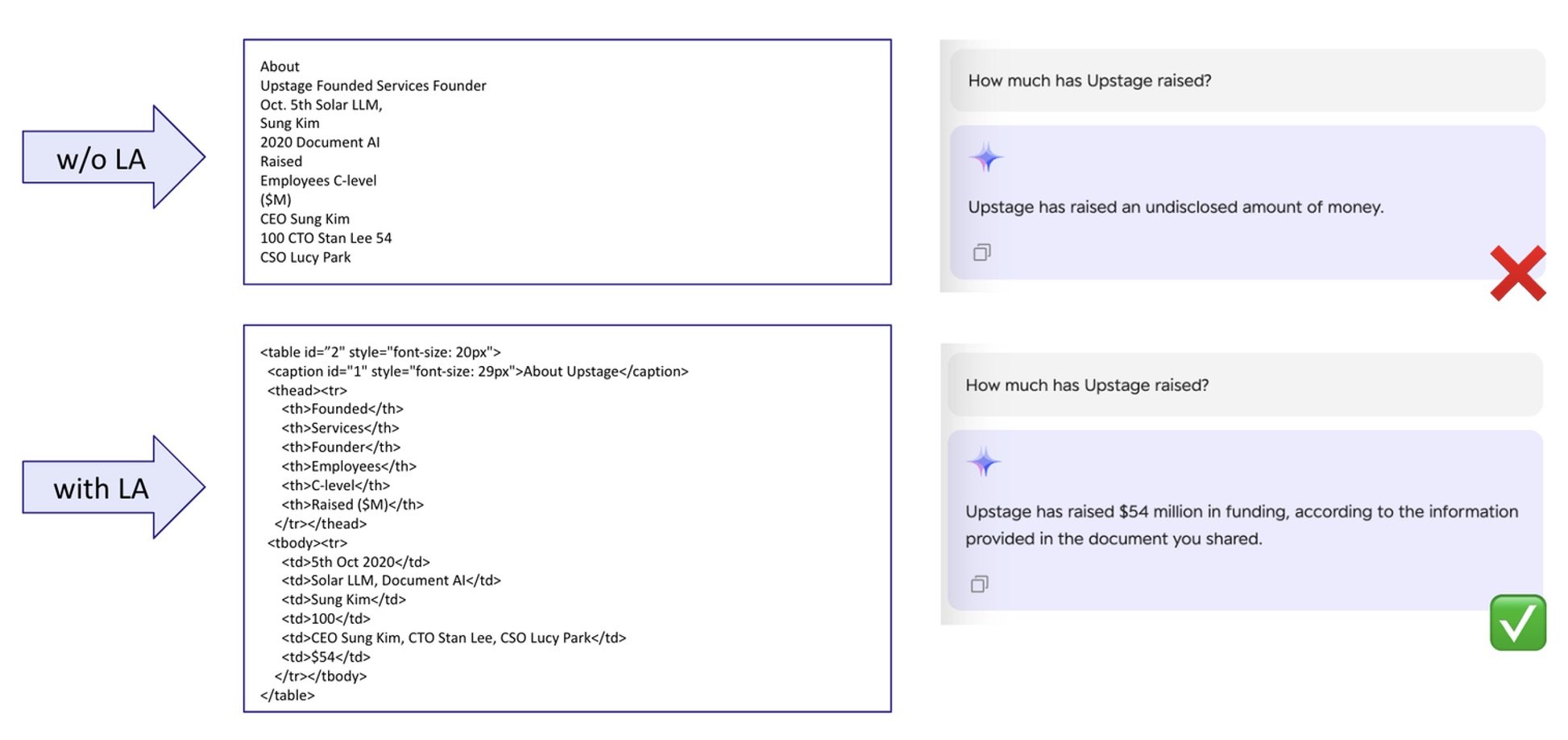

견고한 참조 텍스트를 위한 신뢰할 수 있는 데이터 세트를 만드는 것은 특히 답변이 데이터에 정확하게 근거하도록 하는 데 중요합니다.

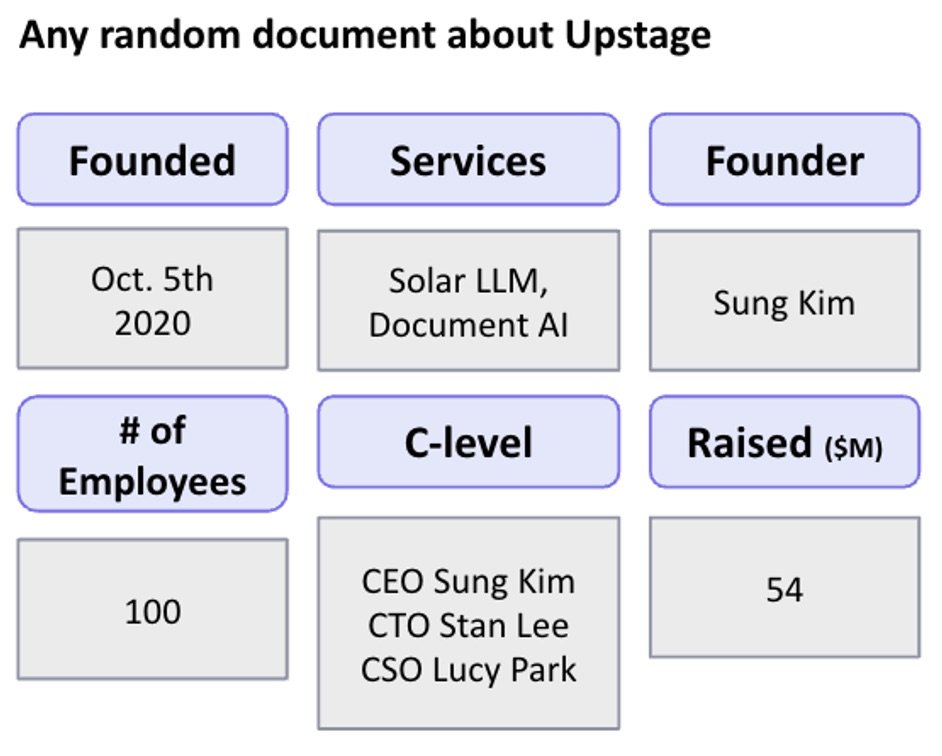

다음은 Upstage에 대한 가상의 무작위 문서의 예입니다.

구조화되지 않은 PDF 형식의 문서를 어떻게 LLM이 답변할 수 있는 근거 자료로 변환할 수 있을까요? OCR(광학 문자 인식)이 언어 모델에 충분한 정보를 제공할 수 있을까요?

LLM이 데이터를 정확하게 해석하려면 문서의 레이아웃을 인식하는 것이 필수적입니다. 단순히 OCR을 수행하면 표나 서식과 같이 문서 레이아웃을 통해 전달되는 암시적 정보를 놓치게 됩니다. 따라서 레이아웃 분석을 포함하는 총체적인 접근 방식은 LLM 통합을 위해 데이터를 철저하게 준비하는 데 매우 중요합니다.

"가비지 인, 가비지 아웃"이라는 딥러닝 진언은 언어 모델에 제공되는 데이터 품질의 중요성을 강조합니다. LLM을 위한 문서를 준비하려면 레이아웃 분석이 귀중한 도구가 될 것입니다.

3. RAG 소개

레이아웃 분석을 통해 만들어진 LLM 준비 데이터로 사용자의 데이터를 임베딩 모델에 임베딩합니다. 텍스트 데이터를 벡터 형태로 변환하여 벡터 데이터베이스를 구축함으로써 검색기가 사용자의 쿼리와 관련된 정보를 찾을 수 있는 기반을 마련합니다.

4. Groundedness Check

Groundedness Check는 마지막 단계로서 시스템의 신뢰성을 크게 강화합니다. 사용자에게 전달되기 전에 LLM의 출력이 참조 문서의 콘텐츠와 일치하는지 검증하여 제공된 정보의 정확성을 보장합니다. 이 중요한 단계는 환각의 가능성을 거의 제로에 가깝게 낮춥니다.

AWS SageMaker Jumpstart에서 'Solar'의 잠재력을 모두 활용해 보세요!

Solar 모델을 시작하려면 두 가지 주요 AWS 서비스를 통해 Solar Mini에 액세스할 수 있습니다: "Amazon SageMaker Jumpstart", 애플리케이션에 쉽게 통합할 수 있도록 Solar Mini를 사전 구축된 기본 모델로 제공하는 머신 러닝 허브, 그리고 "AWS Marketplace"는 Solar Mini의 배포를 간소화하는 선별된 소프트웨어 카탈로그입니다.

Solar LLM을 사용하면 자체 모델을 만들지 않더라도 여러분의 맞춤형 생성 AI 서비스를 쉽게 구축할 수 있습니다. 아래의 영상을 통해 Amazon SageMaker JumpStart에서 Solar를 사용하는 방법을 더욱 자세히 확인해 보세요!